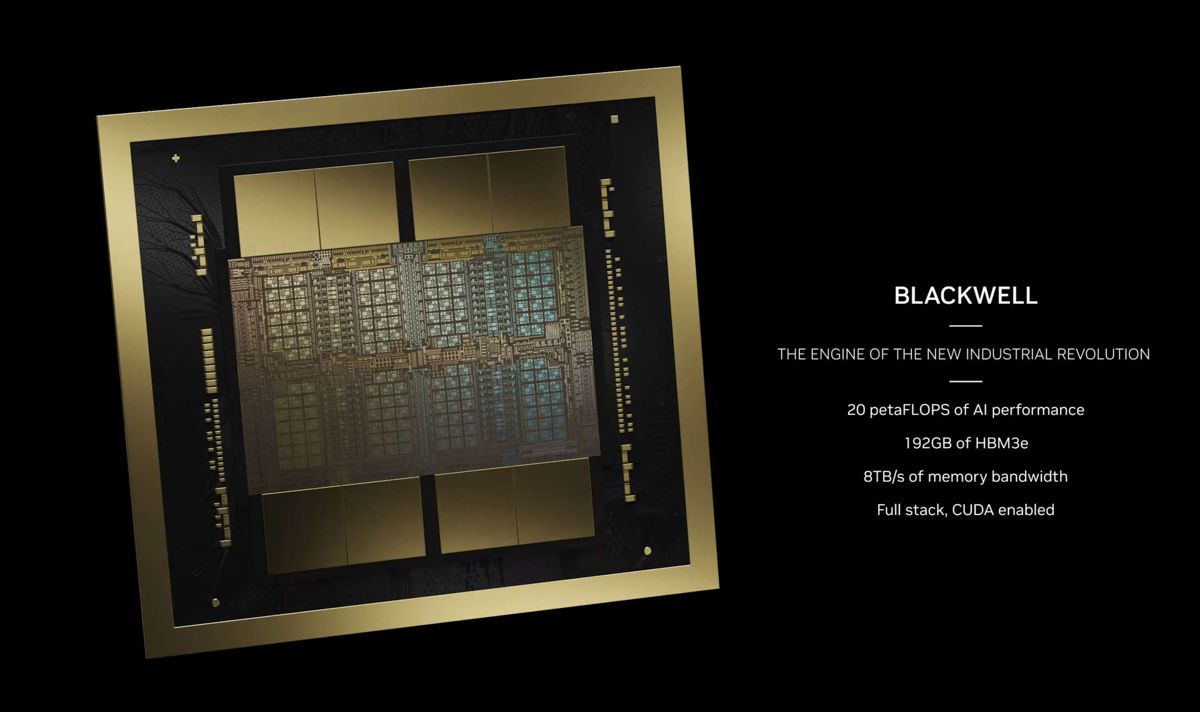

NVIDIA 在 GTC 2024 上面正式發布了 Blackwell 架構 GPU ,包括 B200 晶片,以及透過 NVLink 串兩顆 B200 並搭配 Grace CPU 組成的 GB200 。

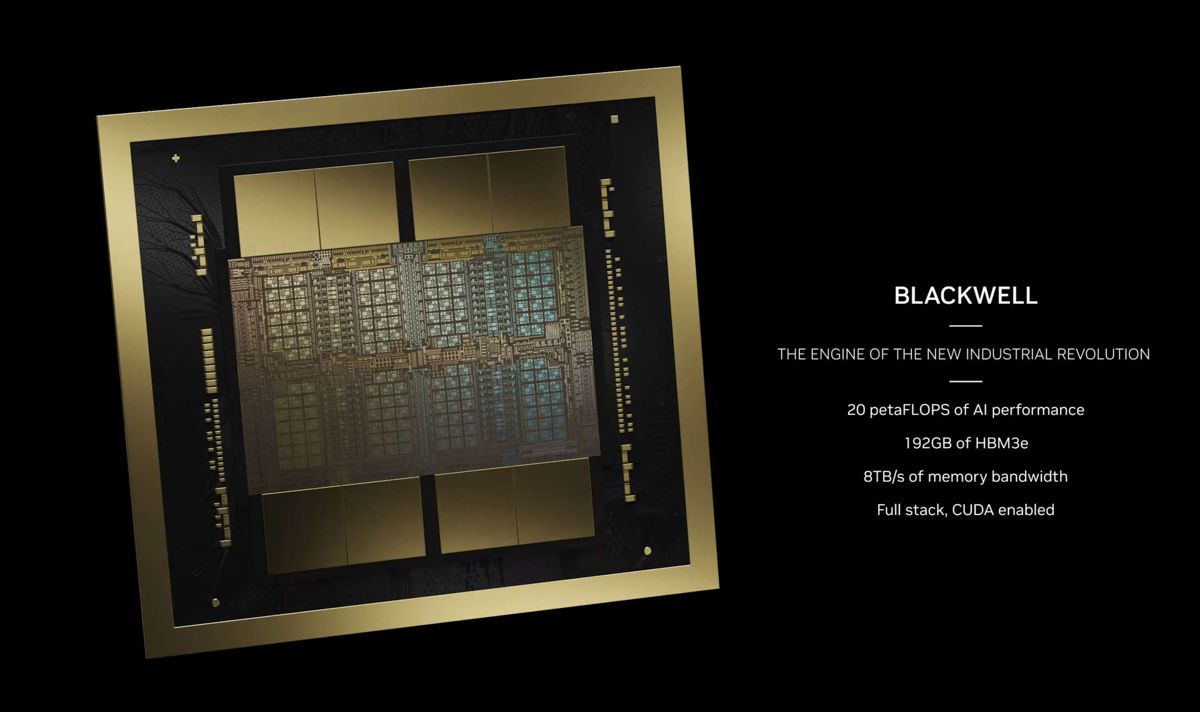

NVIDIA B200 採用台積電 4NP 製程製造整合了兩個獨立的 Die,共有2080億個晶體管,將使用新的 NVLink 5.0 技術來連接兩塊晶片。其擁有160組 SM,對應20480個核心,搭配 192GB HBM3E 記憶體,提供達 8TB/s 的頻寬,功耗達到了700W。

B200 單一 GPU 提供了 20 petaflops 的 AI 效能,是 H100 的 4 petaflops 五倍。由於引入了第二代 Transformer 引擎,將有助於自動將模型轉換為適當的格式以達到最佳性能。此外,Blackwell 架構 GPU 也支援新的 FP6 格式,這是介於 FP4 和 FP8 兩者之間的解決方案。

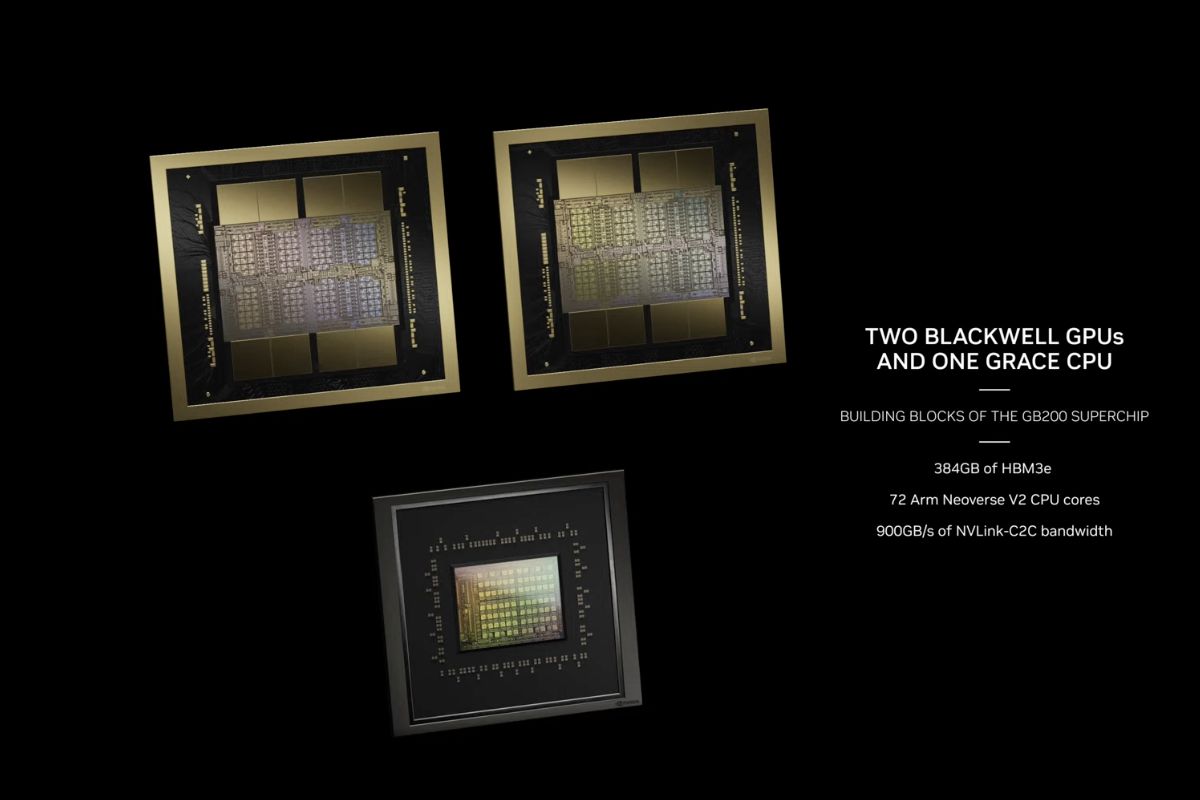

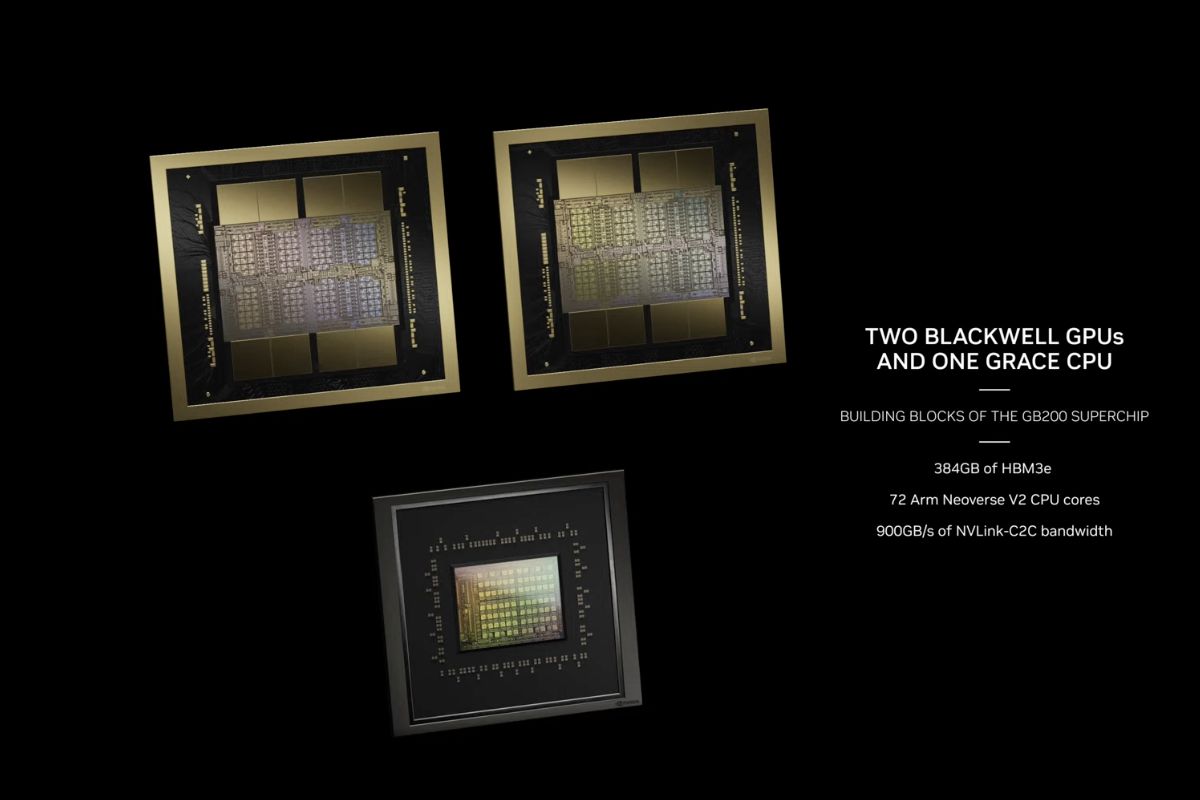

NVIDIA 的 Superchip 被設計為人工智慧(AI)和高效能運算(HPC)工作負載的典型平台,將 Blackwell 架構 GPU 與 Grace CPU 結合推出了 GB200 Grace Blackwell Superchip。其配備了兩個 B200 GPU 和一個 Grace CPU,後者配備72核心的 Arm Neoverse V2 內核,可配置 TDP 高達 2700W。新平台提供了 40 PetaFlops 的運算效能(INT8),並擁有 864GB 的龐大記憶體池,HBM3E 具有 16TB/s 的記憶體頻寬,晶片之間透過 3.6TB/s 頻寬的 NVLink 進行互連。

來源

NVIDIA B200 採用台積電 4NP 製程製造整合了兩個獨立的 Die,共有2080億個晶體管,將使用新的 NVLink 5.0 技術來連接兩塊晶片。其擁有160組 SM,對應20480個核心,搭配 192GB HBM3E 記憶體,提供達 8TB/s 的頻寬,功耗達到了700W。

B200 單一 GPU 提供了 20 petaflops 的 AI 效能,是 H100 的 4 petaflops 五倍。由於引入了第二代 Transformer 引擎,將有助於自動將模型轉換為適當的格式以達到最佳性能。此外,Blackwell 架構 GPU 也支援新的 FP6 格式,這是介於 FP4 和 FP8 兩者之間的解決方案。

NVIDIA 的 Superchip 被設計為人工智慧(AI)和高效能運算(HPC)工作負載的典型平台,將 Blackwell 架構 GPU 與 Grace CPU 結合推出了 GB200 Grace Blackwell Superchip。其配備了兩個 B200 GPU 和一個 Grace CPU,後者配備72核心的 Arm Neoverse V2 內核,可配置 TDP 高達 2700W。新平台提供了 40 PetaFlops 的運算效能(INT8),並擁有 864GB 的龐大記憶體池,HBM3E 具有 16TB/s 的記憶體頻寬,晶片之間透過 3.6TB/s 頻寬的 NVLink 進行互連。

來源